| 送交者: gonewithsmoke[☆★★★声望勋衔15★★★☆] 于 2024-02-08 22:01 已读 8406 次 | gonewithsmoke的个人频道 |

过去一年,我为 AI 花不少钱了,这时代的弄潮儿可不好当。

为了学做插图,我一个月交给 Midjourney 10 美金;后来,ChatGPT Plus 我也订阅了,一个月 20 美金,随便聊,高峰期不用等;再之后是 Perplexity,更贵。

嗯,老板的期望嘛……丨Giphy

老板夸我,“用 AI 武装得不错,但是,工作效率能不能再提一提?你就不能一边写稿子,一边做数据图,再一边写周报邮件吗?”

不愧是老板,这话问得我有点迷糊。

不过好在,刚刚,Google 推出计划,用户可以每月花 19.99 美金订阅 Google One AI Premium,使用支持 Gemini 的 Gmail、Docs,Sheets,Slides 和 Meet——也就是说,你可以在谷歌办公全家桶中畅享 Gemini 的 AI 功能了。

专为打工人准备的20美金套餐……丨Google

自费上班的花销又多了一笔,我看老板这回还能说啥。

都 20 美元,哪一个更值?

同是 20 美金,服务各有千秋。

如果你买了 ChatGPT Plus,能用上 GPT-4,DALL-E 3,当然最让人兴奋的是,OpenAI 创建的类似 App Store 的生态,用别人做的“教学机器人”教小孩数学,再给自己做一个“读书指南”(这世界都清净了不少)。当然也可以借助 Zapier,在 ChatGPT 内将应用连接起来,比如日历—短信(把日程安排通知给同事)。

但是,如果你更习惯传统办公软件的工作流程,想必也疲于了在 ChatGPT 网页和文档间来回切换。

AI 再“务实”一点呢?以学习成本最低的方式,进入普通人如你我的工作和生活。

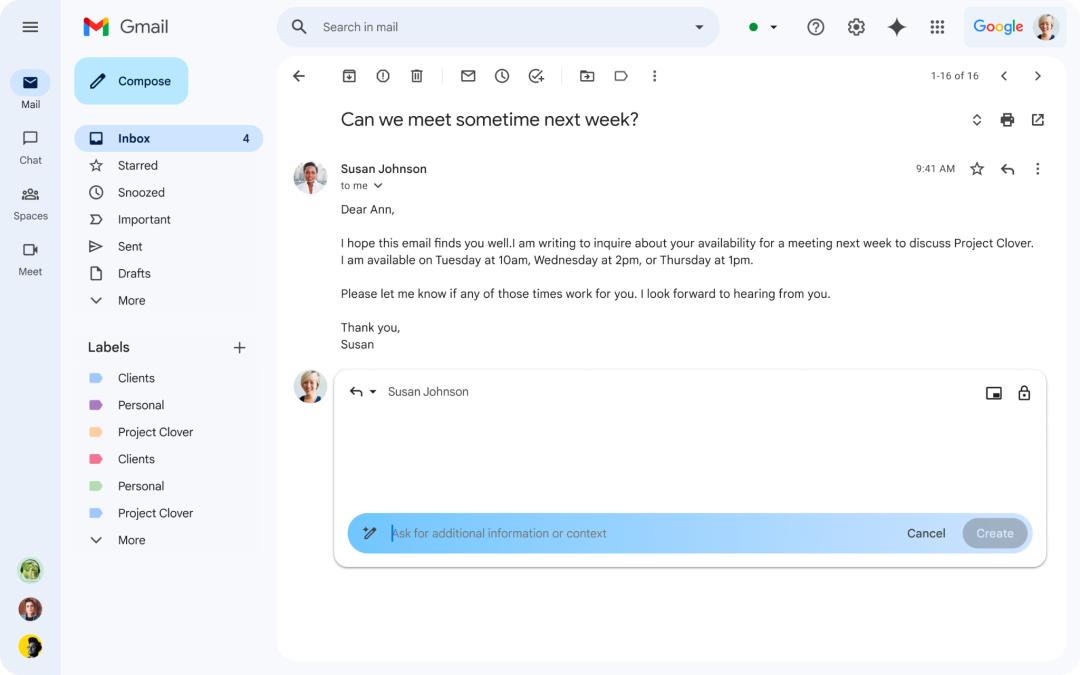

Google 的思路如此:刚刚发布 Gemini Advanced,能在 Docs 中生成文本和总结文档;在 Sheets 里分析数据并生成图表;在 Gmail 上帮你撰写拿捏不准的词句表达等等。

“全家桶”是一种得天独厚的场景优势丨Google

使用 Gemini Advanced 的前提是订阅 Google One AI Premium,Google One 是谷歌提供的在线云存储服务,供其“全家桶”(Google Workspace)使用。所以,AI Premium 的 20 美元中还包含了 2TB 的存储空间。

一个20美元不算贵,但是积少成多啊……丨Google

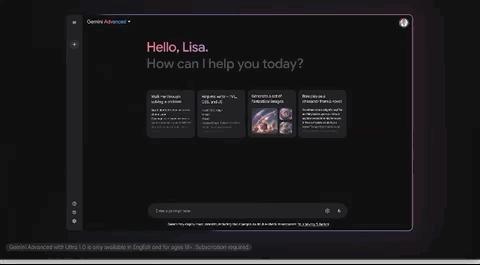

为 Gemini Advanced 供能的是 Gemini Ultra 1.0 大模型,Google 迄今规模最大且功能最强大的模型,适用于高度复杂的任务。模型另外两种尺寸分别是:Gemini Pro ,适用于各种任务的最佳模型;Gemini Nano,端侧设备上最高效的模型。

除了 Google 和 OpenAI 这两家,另一个“20 美元套餐”的选择是微软。也是不久前,微软也推出个人版Copilot Pro,同样每月 20 美金订阅费,就可以使用受到 Copilot AI 能力加持的 Word、Excel、PowerPoint 等。

如果武装不了自己,至少先武装手机

两个月前,谷歌发布了 Gemini,多模态 AI 模型。所谓“多模态”,意指对文字、语音、画面等各种信息形式,同时做到接受,理解,表达。接近人类天然对于外界的理解和交互方式。

Google 之前类 ChatGPT 的 AI 产品叫Bard,现在统称为 Gemini(就是产品名和模型名用一个了,域名也从 bard.google.com 更改为 gemini.google.com),除了网页端,还将推出安卓版的 Gemini App,iOS 用户能在 Google app 中体验到。目前网页端 Bard(很快就都叫 Gemini 了)采用的是 Gemini Pro 模型,支持 40 多种语言对话,包括中文;支持文生图(只支持英文)。

以后,都叫Gemini了丨Giphy

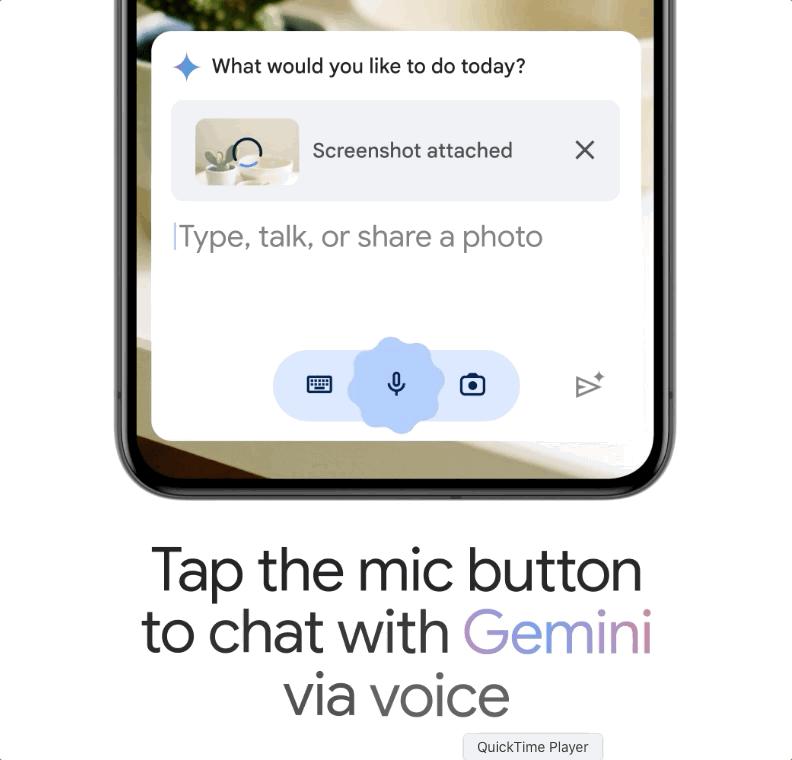

Google 展示中,用手机拍下一张照片,问 Gemini 照片里有什么,它会给你讲,“带刺的仙人掌增添了一丝沙漠的气息;简单形状和自然纹理搭配出一种平静的和谐等等”。(早有这东西,我小学看图写作文,也不至于总不及格。)

手机端的AI应用是更多人期待的丨Google

虽然未展示更多,但可以期待,这样的应用能极大方便我们观察和理解周围环境,比如问它街边的一朵花是十字花科,还是仙人掌科;又或,它把刚听到的一篇“长篇大论”,总结给你听;再或,根据距离传感器和摄像头,综合能告诉盲人,比“前方有障碍物”更多的信息,“它距离你还有五步。”

网页端和手机端,未来都将扩展不同的模态,并逐步支持新的语言和地区。

光有模型才不够,要人人能用

之前 Google 公布对 Gemini 的测试结果时,Gemini Ultra 吊足了胃口:

Gemini Ultra 在大型语言模型研发被广泛使用的 32 个学术基准测试集中,在其中 30 个测试集的性能超过当前 SOTA (最好/最先进)结果。

Gemini Ultra 在 MMLU(大规模多任务语言理解数据集)中的得分率高达 90.0%,首次超过了人类专家,MMLU 综合使用了数学、物理、历史、法律、医学和伦理等 57 个科目,用于测试世界知识和解决问题的能力。

在图像基准测试中,Gemini Ultra 无需对象字符识别 (OCR)的辅助,表现优于以前最好的模型。

基于这些成绩,“Gemini Advanced 将提供一种在推理,遵循指令,编程,和创造性协作方面表现更好的全新体验。”从模型层面来说,增强推理能力和多模态能力是行业基本的共识。

Gemini Ultra终于来了,留给GPT5的时间不多了丨Google

就像刚才提到,多模态 AI 将不同的感知方式互为补充,共同构成对现实世界尽可能全面的描述。它可能不仅是一个能改错别字的挑错工具,而是一个根据你自身风格定制的“编辑”;或者,还能根据你提供的复杂、非结构化的数据,提纲挈领地制定策略。

大家的畅想挺多了。Google说,也已经开始训练 Gemini 的下一个版本。不需要“创造用户界面”,从消费级产品,到开发者API,它说:Gemini 是向着生态发展的。